ライブ・パフォーマンス用のミュージック・ビジュアルを作るには?

ライブパフォーマンスの参考文献

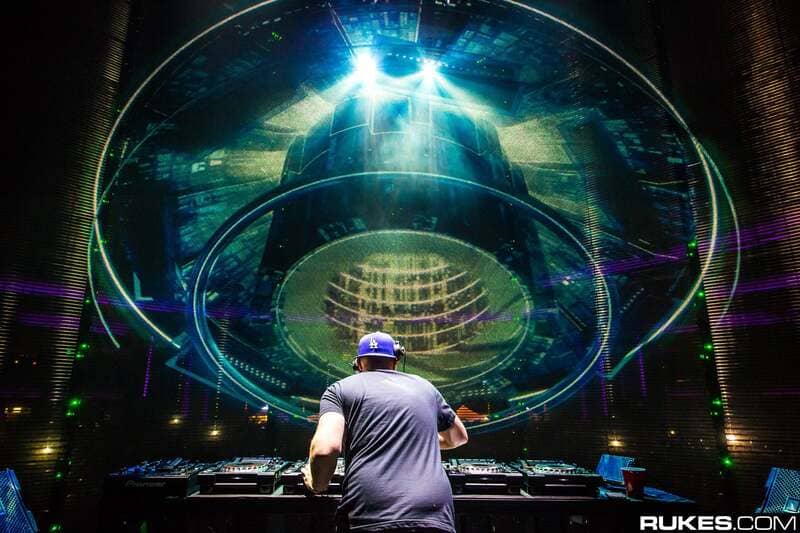

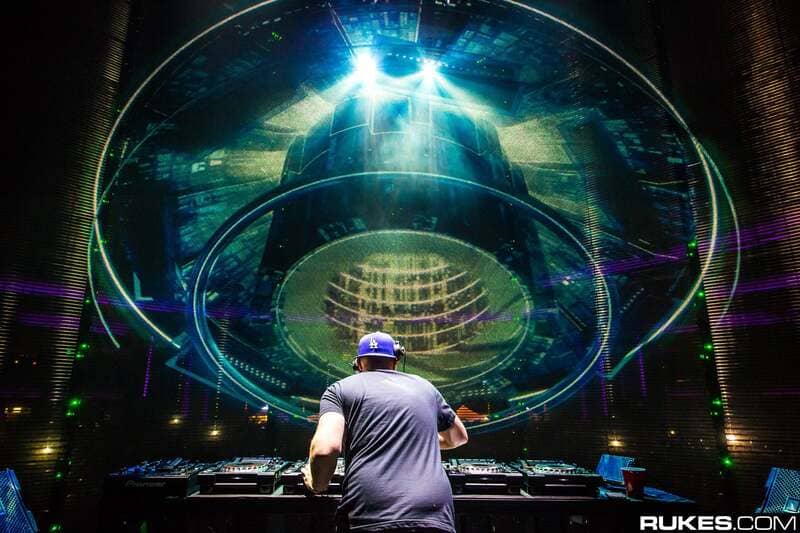

エレクトロニック・ミュージックのファンなら、ステージ装飾に力を入れるアーティストやフェスティバルが増えていることにすでにお気づきだろう。それは通常、固定されたセット要素で構成され、時にはビデオプロジェクションやLEDスクリーンとミックスされることもある。イベント トゥモローランド または ドゥール・フェスティバル などが良い例だろう。アーティストとしては、有名どころでは次のような名前が挙げられる。 エイモン・トビン, エイフェックス・ツイン または エリック・プライズ.彼らは、大規模なステージで音楽と映像の反応を利用した先駆者だった。

しかし、このようなインスタレーションの実施には、長い設計期間と専任のクリエイティブ・チームの協力が必要だ。実際、操作する映像の高解像度と音楽への反応能力は、解決すべき複雑な問題である。ライブ・パフォーマンス中に音と映像の完璧な同期を保証するためには、遅延時間を可能な限り短くしなければならない。さらに、ネットワーク化された複数のコンピューターを使い、互いに同期させる必要があることも多い。クリエイティブなスキルに加えて、技術的な専門知識も必要だ。習得すべきすべてのプロセスは、VJテクノロジーという言葉でグループ化することができ、コンピューターグラフィックス、コンピュータープログラミング、オーディオ・ビデオ信号処理、ライブレコーディング...といった技術に分けることができます。

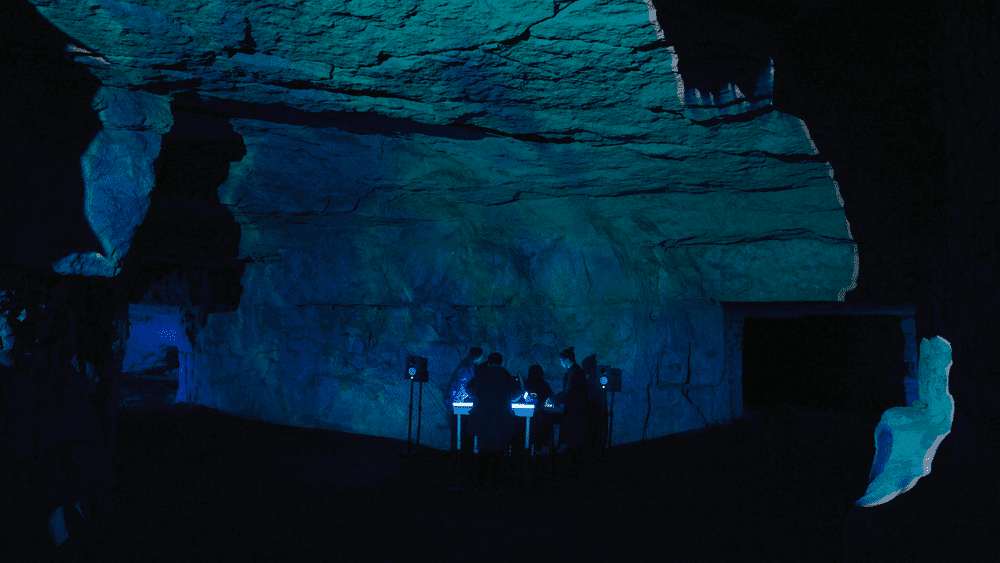

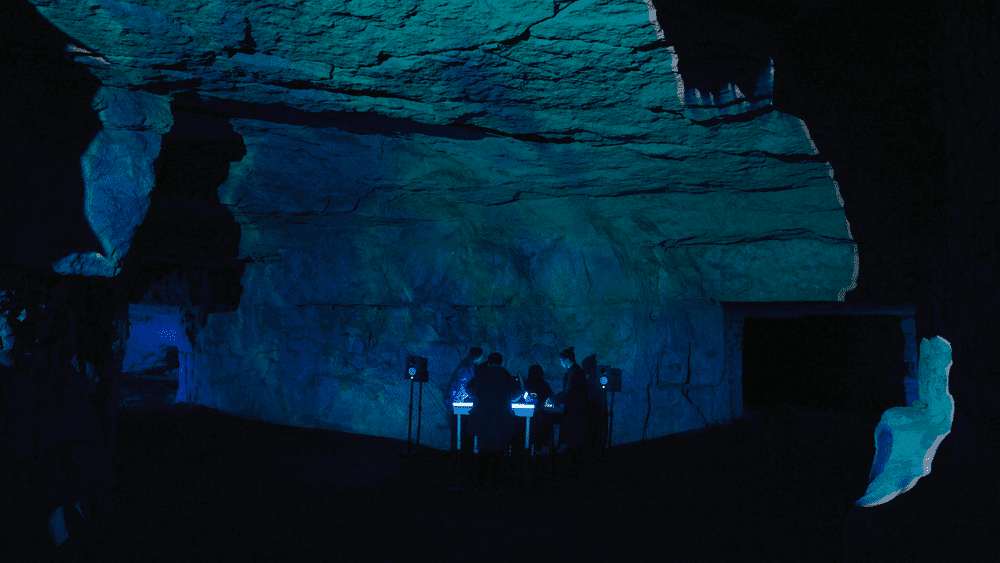

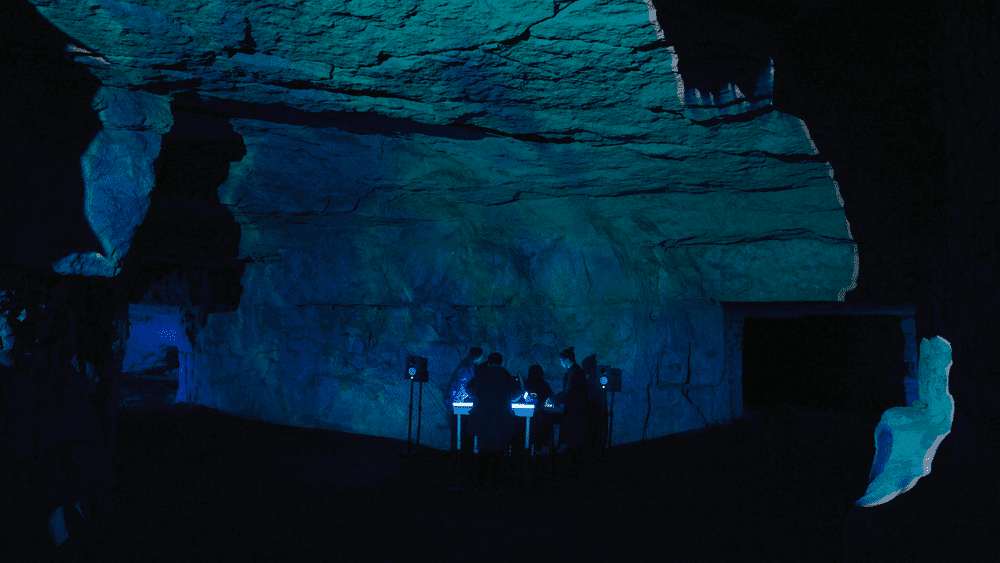

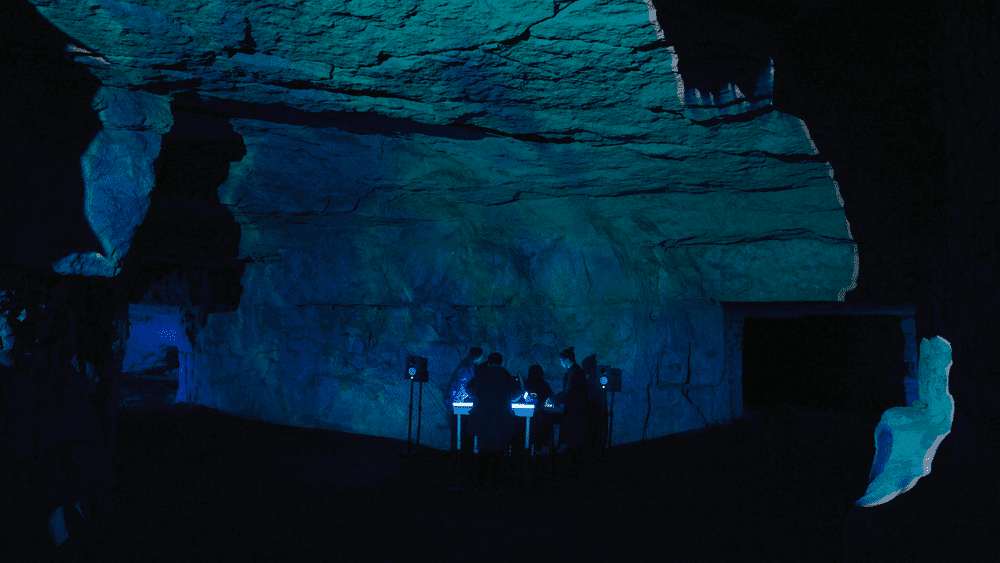

この記事の目的は、小規模から中規模のステージ・パフォーマンスのために音楽と呼応するビジュアルを制作することは、実は思っているほど手の届かないことではないことを示すことである。利用しやすいソフトウェアと手頃な価格のハードウェアがあれば、何週間もかけて制作しなくても、ライブのオーディオビジュアル・パフォーマンスを構築することは十分可能だ。この点を説明するために、アーティストのControl Random、Neurotypique、Marin Scart、Jean-Michel Lightが、石灰岩の採石場での最新パフォーマンスの構想段階を共有した。

ライブビジュアルエフェクトのフォーカスポイント:FPSとレイテンシー。

ライブ・パフォーマンス用に音楽と呼応するビジュアルを制作する場合、次の2点が焦点となる。 ビジュアル・アニメーションの流動性 そして 音楽とビデオの間の遅延.

の速度で画像を生成することが絶対に必要である。 少なくとも毎秒24フレーム。 このデータはフレームレートと呼ばれ、以下の単位で表される。 FPS (フレーム/秒)。この値を下回ると、たとえば12フレーム/秒の場合、すべてのアニメーションがぎこちなく表示されます。速いアニメーションの場合、多くの場合、24 FPS以上の値を目指す必要があります: 30 または 60 FPS.

例えば、非常に速いアニメーションを使ったビデオゲームなどだ、 ゲーマーは、アクションを見逃さないために、解像度よりもフレームレートを優先するフルHDの60 FPSの方が、4Kの30 FPSよりも良い体験ができる。このように、解像度の向上とFPSの向上はトレードオフの関係にある。

視覚効果や複数のHDビデオの同時再生など、リソースを多く消費する処理にコンピュータを使用するほど、FPSの数値は低下する傾向にあります。一般的に、グラフィックカードの設定または使用するソフトウェアの設定によってFPS数値を表示することが可能です。そして、ビジュアルの複雑さと、ライブパフォーマンス中に低下してはならないFPSの上限との間で、最適なバランスを見つけるのはあなた次第です。

レイテンシーについては、音楽で発生したことが映像で反響するまでの遅延のことです。例えば、音楽の「キック」ごとに、オーディオに反応する歪みの視覚効果を関連付けたい。一般的なルールとして、2つの出来事の遅延が100ミリ秒以下であれば、人間には瞬時にリンクして見えると言えます。守るべき値に関する絶対的なルールはありませんが、100msを超える遅延は知覚可能であるとみなされます。 FPSが低ければ低いほど、音楽に反応する視覚効果の遅延が大きくなります。

コンサートやDJセットの場合、音楽が録音されたものでなく生演奏であれば、映像との関係で常に音楽が支配的となる。視覚的なアニメーションに合わせてスロー再生することはできない。したがって、同期していないように見えるように適応しなければならないのは映像の方である。コンピュータの処理速度を落とさないようにアクティブ化されたエフェクトを減らすか、よりパワフルなモデルの使用を計画する。

多くのビデオジョッキー(VJ)が使用する一般的なテクニックは、システムを2つのパートに分けることです:プリレンダリングされたビデオクリップが再生され、一緒にミックスされ、そしてライブで適用される音楽に反応するかしないかのビジュアルエフェクトと組み合わされます。そして、VJが再生される音楽に合わせてスピードを調整できるように、使用されるビデオクリップはすべて同じFPSである必要があります。

ミュージック・リアクティブ・ビジュアルを使ったライブ・パフォーマンスの一例

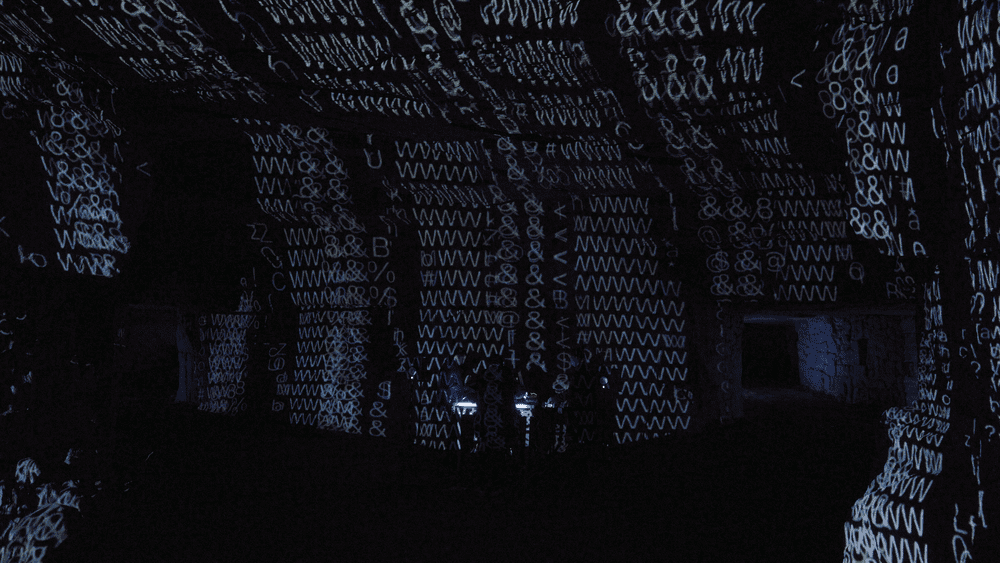

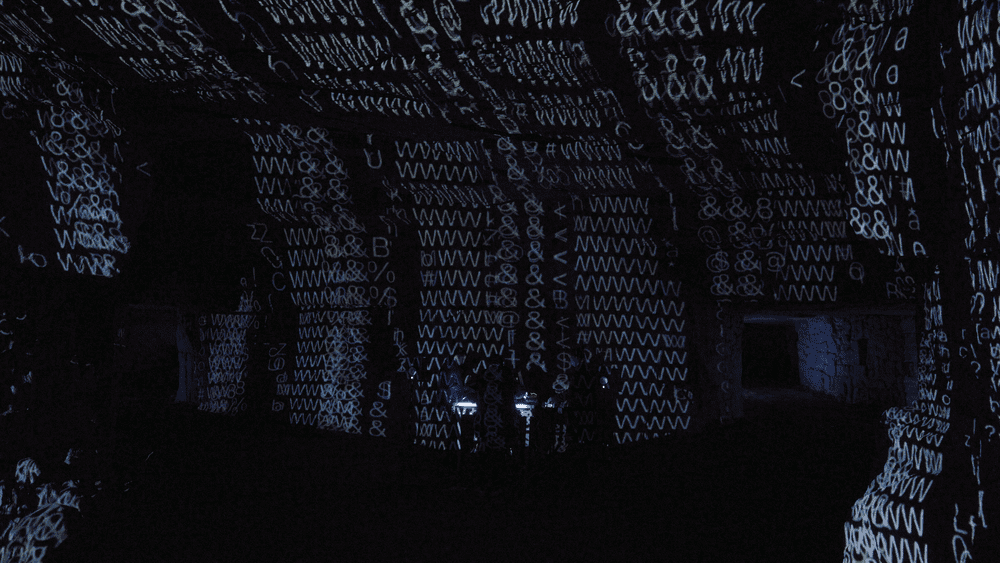

について 石鉱山のマッピング このパフォーマンスは、音と映像の相互作用を探求し、観客の立場を問うようにデザインされている。音楽と映像がライブで作られる、リアルタイムのオーディオビジュアル・パフォーマンスである。

Control Random、Maison Sagan、Marin Scartは、2度と同じことはできない実現というアイデアに心を動かされた。彼らの願いは、それぞれのアーティストの経験や専門性を超えた、学際的なプロジェクトを立ち上げることだった。堆積岩に囲まれていることを意識していた彼らは、この素材の過去、現在、未来、さまざまな状態を問い、その未来に自分自身を投影したいと考えた。この5部構成の旅では、音楽とリアクティブ・ビジュアルが、音声とCV情報を使って音とリンクし、画像作成ソフトのジェネレイティブ・パッチを駆動させる。

このライブの出演アーティスト

実際:ライブ・パフォーマンスの視覚効果に使用されるソリューション

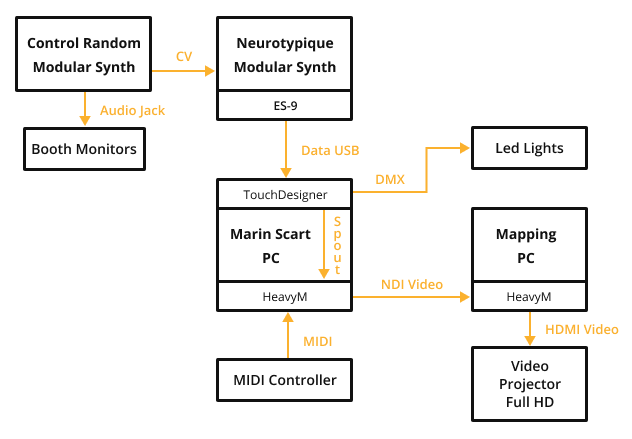

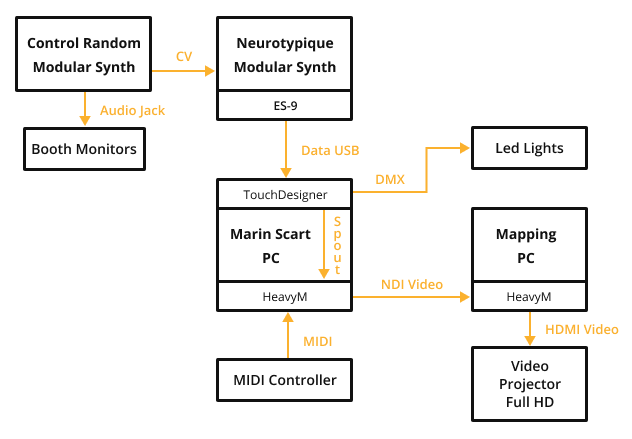

音楽に合わせてリズムを刻むビジュアルを創り出すため、ニューロティピックとマリン・スカートはシステムのさまざまな要素を相互接続した。コントロール・ランダム社のモジュラー・シンセサイザーは、オシレーターから音波を生成するエレクトロ・アナログ楽器である。生成された様々な信号はニューロティピックのモジュールに送られ、フィルタリングやターンオン/ターンオフの操作が行われる。その後、アナログ信号はデジタル信号に変換され、Marinのコンピューターで解釈される。TouchDesignerは、音楽に反応するビジュアル・エフェクトを生成することができ、それはHeavyMによって適用されたシェーダーで修正され、最終的にはMIDIインストゥルメントでライブ・コントロールされる。最後に、ビデオ信号はマッピングを行う2台目のコンピューターに送られる。

ライブ・パフォーマンス・システムの概要

音源:モジュラー・シンセサイザー

オシレーター、フィルター、エフェクト......組み合わせの可能性は無限大で、アーティストは自分だけの音楽を生み出すことができる。Control RandomとNeurotypiqueは、モジュラー・シンセサイザーの標準フォーマットであるEurorackシステムを採用している。使用可能なモジュールは モジュラー・グリッド ウェブサイトをご覧ください。その数は11,000以上!

もちろん、音楽と同期したビジュアル・エフェクトを作るためにモジュラー・シンセサイザーを使う必要はありません。DJミキサー、コンピュータージャック、マイクなど、どんなソースでも使えます。

コンピュータ

ライブパフォーマンス中の遅延問題を避けるため、フレームレートを60FPSに近づけるために、アーティストは2台のコンピュータを使うことにした。この構成により、処理をよりうまく分散させ、マシン間で作業負荷を分けることができます。このソリューションの他の利点は、互いに干渉することなく2人1組で作業できることと、パフォーマンスのセットアップ中に問題をより簡単に特定できることです。

視覚効果コンピューター

オーディオ情報を送信するコンピューターは、Windows 10、インテルi7プロセッサー、Nvidia Geforce GTX 1650グラフィックカード、16GBのRAMを搭載したタワー型PCである。

TouchdesignerとHeavyMはこのコンピュータで動作しています。

画像歪みコンピューター

映像を空間にフィットさせるために使用されるビデオマッピングコンピューターは、ウィンドウズ10、インテルi5プロセッサー、Nvidia Geforce GTX 1050グラフィックカード、8GBのRAMを搭載したノートパソコンだ。

このコンピュータではHeavyMだけが動作している。

ビデオマッピングコンピュータを選ぶ際のヒントについては、以下をご覧ください。 コンピューター専用記事.

プロジェクター

使用したプロジェクターはオプトマWU630 6000ルーメンのフルHDで、焦点距離比0.9の短焦点光学系。

ビデオプロジェクターを選ぶ際のアドバイスについては、以下を参照してください。 専用記事 ビデオプロジェクターで。

LEDライト

側面のトンネルを照らすライトは以下の通り。 アステラ・チタン・チューブ バッテリーに

レスポンシブ・オーディオ・ビジュアル・エフェクト・ソフトウェア

タッチデザイナー

NeurotypiqueとMarin Scartは、Touchdesignerソフトウェアで自作曲をプログラミングした。

開発元 デリバティブTouchdesignerは、ノード・プログラミング・システムを使用して、リアルタイムの視覚効果を作成することができます。Touchdesignerの強みは、ライブ・パフォーマンスに完璧に適応したグラフィック・パイプに関連する、無限の可能な組み合わせです。ただし、思い通りのものを作るには、使いこなすのに時間がかかります。

HeavyM

HeavyM は、Digital Essence社によって開発され、数クリックで音楽レスポンシブ・エフェクトを作成することができます。Stone Mine Mappingプロジェクトでは、HeavyMは2つのレベルで使用されました。1つ目は、Touchdesignerのビデオ出力での、処理エフェクトシェーダーの使用です。もう1つは、投影スペースに合わせて画像全体を歪めることです。

HeavyMはオーディオ分析機能を直接統合し、再生中の音楽に反応するビジュアル・エフェクトの機能を提供します。コンピュータとオーディオソースをジャックケーブルなどで接続するだけです。外部サウンドカードを使用することもできます。

パフォーマンス・コンポーネント間のコミュニケーション

音楽に反応するビジュアルを生成するためには、さまざまなハードウェアとソフトウェアの要素が必然的に情報を交換しなければならない。

モジュラー・シンセサイザーは、オーディオ情報を特定のモジュールを通して送信する: ES-9 エキスパート・スリーパーズ.これは電気信号をTouchdesignerが理解できるデジタルデータに変換するアナログ・デジタル変換器です。HeavyMにはオーディオ分析機能が直接統合されており、再生される音楽に視覚効果を反応させることができるため、この種のハードウェアを用意する必要はありません。コンピュータをオーディオソースにジャックケーブルなどで接続するだけです。外部サウンドカードを使用することもできます。

音楽情報を受信すると、Touchdesignerはビジュアル・アニメーションを生成し、HeavyMに送信します。 スパウト リンク。これは、あるソフトウェアのビデオ出力を別のソフトウェアに送信する技術です。HeavyMはビデオを受信し、MIDIコントローラを使用して、Marin Scartは追加の視覚効果を適用します。HeavyMの出力は、MIDIコントローラを使用して、2台目のコンピュータ上のHeavyMの別のインスタンスに送信されます。 NDI技術.これにより、ビデオストリームを最小のレイテンシーでネットワーク上に配信することができる。最後に、HeavyMはビデオのジオメトリを修正してビデオプロジェクターに送り、プロジェクターはライブパフォーマンス空間にビデオを表示する。

ビデオ投影を完成させるために、サイドにLEDライトが追加された。これはプロジェクションの色に合わせたものです。照明の制御信号は、TouchdesignerからWifiネットワーク経由で送信されるDMXメッセージです。

君の番だ!

ライブ・パフォーマンス用の音楽レスポンシブ・ビジュアルを作成するには、インターネットで簡単に検索できる技術的な知識が必要だ。一方、必要なハードウェアは、コストや理解の面で、ますます身近なものになっている。石山マッピング・プロジェクトは、最初は複雑に見えるかもしれないが、利用可能なツールやテクニックの概要を提供するという利点がある。コンピューター1台とスピーカーだけで、もっとシンプルなシステムを考えることも可能だ。多くのオーディオビジュアル・パフォーマーは、必ずしもオーディオとビデオのリンクを作らなくても、聴いた音楽に従って "耳で "操作をすることで満足している。その結果、コンピュータに勝手に判断させるよりも、より適切な結果が得られることもある。

続きはこちら

HeavyMのソフトを調べる

HeavyMは、ビデオマッピングソフトウェアで、以下のことが可能です。 ビジュアルエフェクトの生成 を、ボリューム、装飾、建築要素に投影することができます。HeavyMは MacとWindowsに対応.